A mesterséges intelligencia (AI) robbanásszerű fejlődése egyre közelebb hozza azt a jövőt, ahol a robotok nem csak előre programozott feladatokat végeznek, hanem intelligensen reagálnak a környezetükre, értik a beszédet, és önállóan cselekednek. Ez egy olyan áttörést hozhat, mint a ChatGPT az AI területen, amihez érdekes ízt ad, hogy a robotika tulajdonképpen ősibb tudomány mint az AI. De mi is a kettőnek a köze egymáshoz, ez hogy is működik?

VLM (Látás és nyelv)

Kezdjük az alapokkal! A VLM, vagyis Vision-Language Model egy olyan AI-modell, amely képes feldolgozni mind a vizuális információkat (képeket, videókat), mind a természetes nyelvet (szöveget vagy beszédet). Gondoljunk rá úgy, mint egy „szem” és „fül” kombinációjára egy agyban: a modell „látja” a világot kamerákon keresztül, és „érti” az utasításokat, mint például „Vedd fel a piros almát az asztalról!”.

A VLM-ek általában két fő részből állnak. Egy képfeldolgozó (image encoder) elemzi a vizuális inputot, például azonosítja tárgyakat, színeket vagy pozíciókat. Egy nyelvfeldolgozó (language model, pl. GPT-szerű) pedig értelmezi a szöveget, és összekapcsolja a kettőt. Például egy VLM képes válaszolni kérdésekre egy képről, mint „Mi van a képen?” vagy leírni, mit lát. Ezek a modellek hatalmas adathalmazokon tanulnak, ahol képek és szövegek párosítva vannak, így „megtanulják” a világot leíró kapcsolatokat.

A VLM-ek lehetővé teszik, hogy a robotok értelmezzék a környezetüket.

Mi az a VLA? (VLM + Cselekvés)

A VLA, vagyis Vision-Language-Action modell a VLM továbbfejlesztett változata, amely hozzáadja a „cselekvés” (action) elemet. Itt már nem csak látás és nyelv van játékban, hanem a robot fizikai mozgásának irányítása is. A VLA-modellek képesek közvetlenül generálni parancsokat a robot motorjainak, például „Emeld fel a karod 30 fokkal!” vagy „Fordulj balra!”.

A VLA-k tanulása gyakran imitáción alapul: a modell videókon vagy demonstrációkon keresztül figyeli, hogyan végeznek feladatokat emberek vagy más robotok, majd ezt utánozza. Ezek a modellek integrálják a vizuális percepción (látás), a nyelvi megértést (utasítások) és a cselekvési tervet (mozgás). Például egy VLA képes egy konyhában navigálni, tárgyakat felismerni, és azokat manipulálni, miközben folyamatosan korrigálja magát a visszacsatolás alapján.

A VLA-k különösen hasznosak komplex feladatoknál, mint a ruha hajtogatása vagy egy konyha takarítása, mert képesek logikusan gondolkodni: „Ha ez akadályoz, akkor toljam arrébb!” Ez teszi őket „okos” robotirányítókká.

A fogalmakról bővebben a fogalomtárban is olvashatsz.

Példa a gyakorlatban: Google Gemini Robotics 1.5

A Google DeepMind legújabb fejlesztése, a Gemini Robotics 1.5 egy kiváló példa a VLA-alapú robotirányításra. Ez egy multi-embodiment modell, ami azt jelenti, hogy különböző robot testekben (pl. karok, humanoidok) is használható. Az egyik nagy újítás benne az, hogy „agentic” önálló módon több lépéses feladatsorokat is képes végrehajtani.

Extra: nyers nyelvi modell irányít robotot

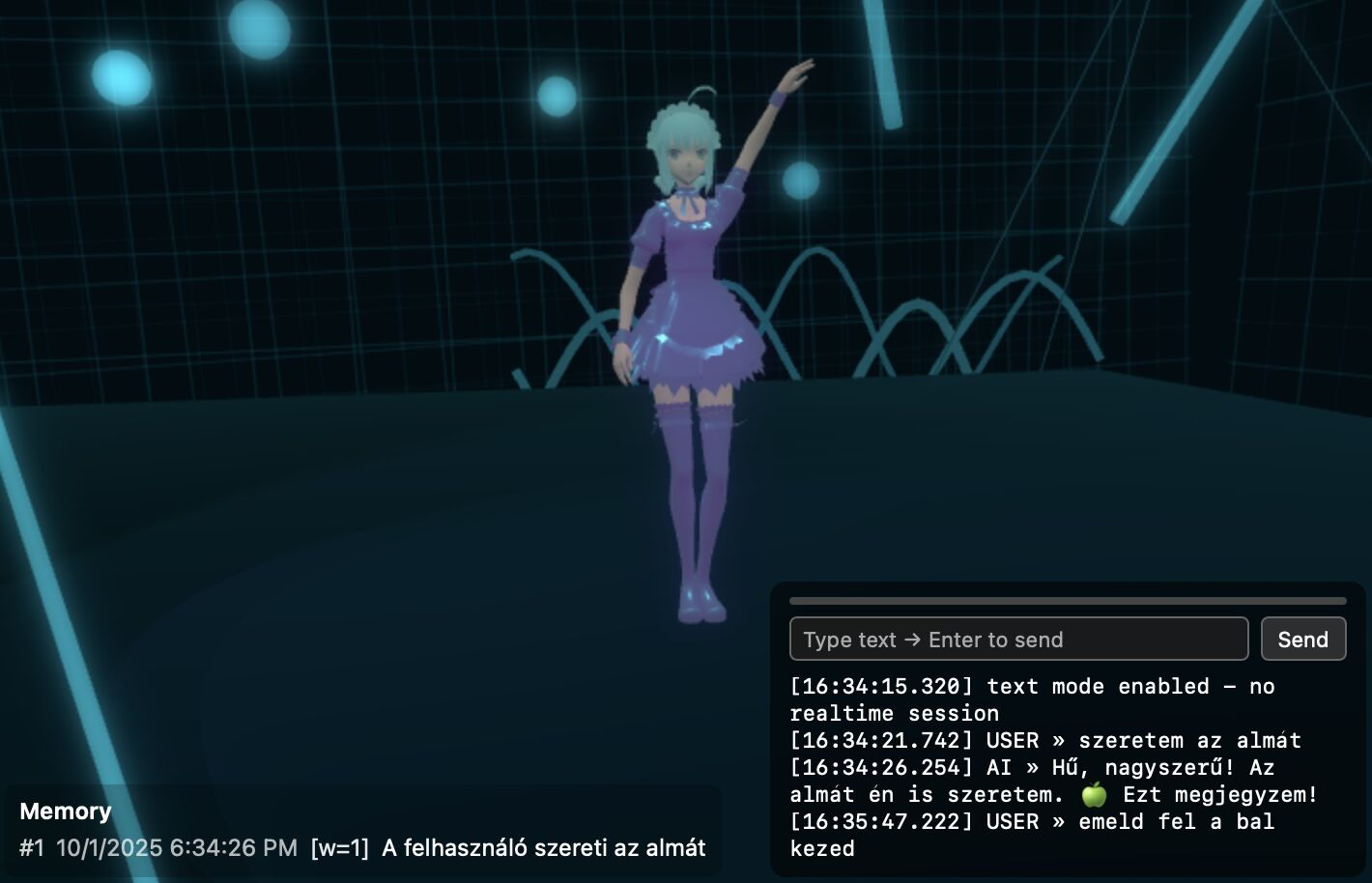

Az aiszakerto.hu blogon is írtam „megtestesülő AI” koncepcióját. Itt a fejlett nyelvi modell veszi át a magasabb szintű vezérlési feladatokat. Kis közelítéssel mondhatjuk, hogy képernyőről kiköltözve „testet ölt” egy robotban vagy avatárban: irányíthat robotokat koordinátákkal, mozgatva a tagokat. A Google feltanít rá egy speciális AI modellt, de a cikk bemutatja, hogy egy sima nagy nyelvi modell is képes „AI marionett bábu” irányítására (most virtuális térben).

A mi biológiai agyunkban is több rétegben történik a a végső mozgás összeállítása. Leegyszerűsítve az ősibb rétegek, az agytörzs és a kisagy stb. felel az alap mozdulatokért, pl. járás és egyensúlyozás finom mozgásai, amiken nem gondolkodunk. A szürkeállomány motoros kérge felel a mozgások elindításáért, míg a prefrontális kéreg a stratégiai döntésekért (mihez nyúljak, hova menjek).

Összefoglalva, az AI így képes arra, hogy ne csak gondolkodjon, hanem cselekedjen a fizikai világban.